| [ChatGPT] 챗GPT 대화 생성을 위한 모델 아키텍처 |

대화 생성은 인공지능 모델을 사용하여 자연스러운 대화를 생성하는 과정을 말합니다.

이번 글에서는 대화 생성을 위한 일반적인 모델 아키텍처를 살펴보겠습니다.

■ 인코더-디코더(Encoder-Decoder) 아키텍처

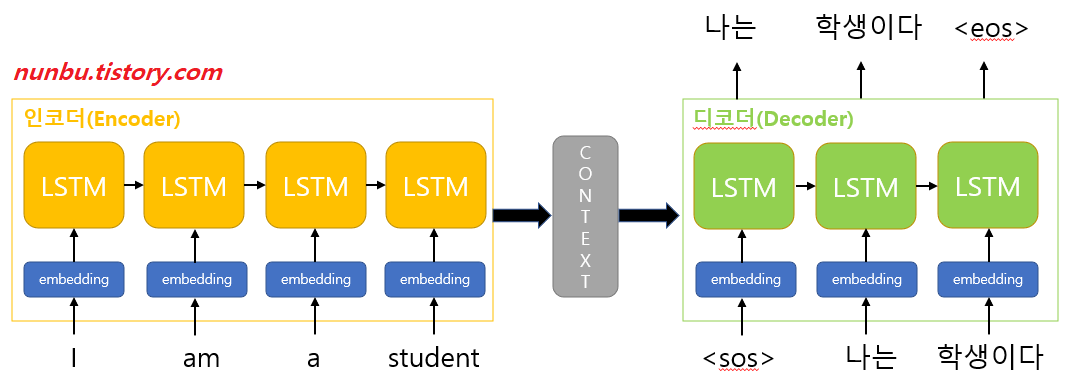

인코더-디코더 아키텍처는 시퀀스-투-시퀀스(SEQ2SEQ, sequence-to-sequence) 모델링에 사용되는 신경망 아키텍처로,대화 생성에 널리 사용되는 모델 구조입니다. 이 아키텍처는 두 개의 주요 구성요소가 있습니다. 인코더와 디코더.

인코더는 입력 시퀀스를 고정된 길이의 벡터로 변환하는 역할을 합니다. 이 벡터는 입력 시퀀스의 정보를 압축하여 나타내며, 컨텍스트 벡터라고도 합니다. 즉, 입력 문장을 임베딩하여 의미를 인코딩하는 역할을 수행합니다.

디코더는 컨텍스트 벡터를 사용하여 출력 시퀀스를 생성합니다. 디코더는 컨텍스트 벡터와 이전에 생성된 출력 토큰을 입력으로 받아 다음 출력 토큰을 예측합니다. 즉, 인코더에서 생성된 의미 표현을 기반으로 응답 문장을 생성하는 역할을 수행합니다.

다음은 인코더-디코더 아키텍처의 간단한 다이어그램입니다:

■ 장단기 메모리(Long Short-Term Memory, LSTM)

장단기 메모리는 인코더-디코더 아키텍처에서 주로 사용되는 순환 신경망(RNN)의 한 종류입니다. LSTM은 시퀀스 데이터에서 장기 의존성을 학습하고 기억할 수 있는 능력을 갖추고 있습니다. 대화 생성에 적합한 모델로, 문장의 문맥과 의도를 이해하며 자연스러운 대화를 생성할 수 있습니다.

■ 어텐션(Attention) 메커니즘

어텐션 메커니즘은 대화 생성에서 중요한 요소로 사용됩니다. 어텐션은 디코더가 입력 시퀀스의 특정 부분에 집중하도록 하는 메커니즘입니다. 디코더는 인코더의 출력과 어텐션을 사용하여 입력 시퀀스의 각 단어의 중요성을 계산하고, 이를 통해 보다 정확한 응답을 생성할 수 있습니다.

■ 적대적 생성신경망(Generative Adversarial Network, GAN)

GAN은 최근 대화 생성 분야에서 주목받는 모델입니다. GAN은 생성자와 판별자라는 두 부분으로 구성되며, 생성자는 자연스러운 대화를 생성하고, 판별자는 생성된 대화를 판별하는 역할을 수행합니다. 이를 통해 모델은 점점 더 현실적인 대화를 생성하도록 학습할 수 있습니다.

대화 생성을 위한 모델 아키텍처는 계속해서 발전하고 있으며, 더 나은 대화 경험을 제공하기 위해 연구와 개발이 진행되고 있습니다. 이러한 모델들은 사용자와 자연스럽게 소통하며, 다양한 분야에서 활용될 수 있습니다. 앞으로 더욱 발전된 모델을 통해 더욱 풍부하고 유익한 대화를 즐길 수 있기를 기대해봅니다.

'Data & Programming > ChatGPT' 카테고리의 다른 글

| [ChatGPT] Stable Diffusion WebUI 한글화 작업 (1) | 2023.07.09 |

|---|---|

| [ChatGPT] Stable Diffusion WebUI 설치과정 (0) | 2023.07.08 |

| [ChatGPT] 챗GPT 작동 방식 (0) | 2023.06.25 |

| [ChatGPT] 챗GPT와 GPT의 차이 및 대화형 모델의 특징 (1) | 2023.06.25 |

| [ChatGPT] 챗GPT 소개 : 대화형 인공지능 언어 모델의 미래 (0) | 2023.06.25 |